La Inteligencia Artificial (IA) y la Historia

Por Carlos Rilova Jericó

Seguramente ante ese nuevo correo de la Historia habrá quienes se planteen una buena pregunta. Y esa sería ¿y qué tiene que decir la Historia, que es la ciencia que se ocupa del pasado, de algo que ocurre en el presente y es casi futuro como la IA?

Seguramente ante ese nuevo correo de la Historia habrá quienes se planteen una buena pregunta. Y esa sería ¿y qué tiene que decir la Historia, que es la ciencia que se ocupa del pasado, de algo que ocurre en el presente y es casi futuro como la IA?

Es una pregunta razonable, desde luego, pero la respuesta que procede no tiene más remedio que señalar que, en absoluto, esta cuestión de la Inteligencia Artificial, AI, Cibernética, Robotización… o como se la quiera llamar, es un asunto sólo del presente.

Y es que el tiempo no pasa en vano, según dice la frase tópica, y ya tiene unos cuantos años todo el revuelo periodístico que se ha planteado ahora mismo por las enésimas declaraciones de Elon Musk y otros -como un ex-ejecutivo de Google o el más radical Eliezer Yudkowsky- acerca de que hay que replantearse el permitir un rápido avance de la Inteligencia Artificial.

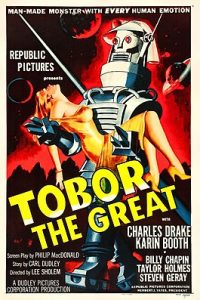

Así es, apenas acabada la Segunda Guerra Mundial eruditos escritores de ciencia-ficción (¿y quién si no?) ya estaban planteando esa problemática.

Uno de ellos fue Isaac Asimov, descendiente de una de las numerosas familias rusas que se fueron a Estados Unidos buscando una vida mejor. No era cualquiera: doctor tanto en Bioquímica como en Filosofía (valga decir en Historia), profesor y un gran divulgador de las ciencias llamadas “exactas” y sociales. Como esa misma Historia.

Todo ello aparte de escribir, de manera incansable, eso que en el siglo XIX se llamaba no tanto ciencia-ficción como “novelas de anticipación” (nada menos que Jack London fue uno de los que aplicó el término). Muchas de ellas seriales que giraban en torno, justamente, a los problemas que podría generar en un futuro próximo la Cibernética, la Robótica, en fin, la Inteligencia Artificial.

Fue Asimov, precisamente, quien crea para una de esas series de novelas las llamadas tres leyes de la Robótica que impedirían, de manera redundante (o algorítmica si se prefiere) que una de esas máquinas inteligentes dañase por intención, por error o por omisión a un ser humano. Leyes que, sin embargo, el muy inteligente doctor Asimov consideraba se podrían atajar y burlar.

Hace unos meses por ejemplo hablaba yo en otro correo de la Historia de un episodio titulado “Solaria”, incluido en una de sus novelas, en el que el buen doctor mostraba eso precisamente: como una sociedad humana que había evolucionado más allá de lo que en los últimos cien mil años hemos llamado “humano”, era servida por un ejército de autómatas muy dotados de esa Inteligencia Artificial y que no tenían reparo en dañar a los humanos genuinos para proteger a sus amos.

No era esa la única ocasión en que Asimov se planteaba esos problemas. En un relato anterior, titulado “La última pregunta”, abundaba en ello. Ese cuento corto se publicó en 1956 en la revista “Science Fiction Quarterly” y en él unos desganados seres humanos del año 2061 (a la vuelta de la esquina en términos históricos) planteaban a una primitiva Inteligencia Artificial si no era posible detener el proceso de desgaste continuo de la energía (o entropía) que debería llevar finalmente a la extinción de nuestro universo. Después de esa primera pregunta, durante trillones de años en el futuro, los seres humanos -que siguen evolucionando hasta hacerse etéreos sin forma física- siguen planteando lo mismo a una IA que se acaba fusionando con lo que queda de esa Humanidad hasta que se extingue el último átomo de energía del universo…

Momento en el que esa entidad pronuncia la bíblica frase “Hágase la luz” y, evidentemente, todo vuelve a comenzar en una especie de irónico bucle sin fin de creación y recreación eterna del Universo. Seres humanos incluidos.

Parece ser que esa era la respuesta del buen doctor Asimov a otro cuento corto de ciencia-ficción producido, éste sí, por un escritor al uso: Fredric Brown, dipsómano conspicuo -erigió todo un monumento al asunto en su irónica novela “¡Marciano, vete a casa!”- y con ribetes de autor maldito.

El relato se titulaba “La pregunta”, apenas ocupaba un folio y en él se relataba como ante toda la Prensa -reunida para la gran ocasión- los científicos que habían creado una Inteligencia Artificial poderosísima la ponían en marcha y planteaban una pregunta curiosa y que ha atormentado a los seres humanos durante siglos: “¿existe Dios?”. La respuesta venía tras aparecer un rayo de la nada -en medio de un cielo despejado- que quemaba el interruptor de encendido y apagado de la supermáquina. La cual, justo después de declararse así independiente de sus creadores (y del resto de humanos) respondía: “Ahora sí”…

Los relatos de Asimov, pero sobre todo el de Brown, dejaban claro el problema de la Inteligencia Artificial: ésta, una vez desarrollada, puede considerar que los humanos deben ser cuando menos controlados como un peligro o, incluso, exterminados. Todos ellos, incluso los que la han creado.

La evolución vulgar de esas reflexiones entre eruditas y satíricas de Asimov y Brown seguro que es bien conocida porque la saga cinematográfica “Terminator” (repetida hasta la saciedad en las televisiones desde hace décadas) planteaba ese escenario no en el futuro, sino prácticamente en nuestro presente. Una vez que la Inteligencia Artificial ha destruido -como en el cuento de Brown- el interruptor desde el que los seres humanos podrían controlarla. Lo que seguía a eso, naturalmente, era la aniquilación sistemática de toda vida humana por una IA que no tenía, por supuesto, vínculo emocional alguno con esos seres tan imperfectos, tan caóticos, tan perecederos y tan opinables como los humanos que, para esa IA, también por supuesto, estaban de más en un mundo en el que ellos la privaban de los recursos necesarios para su supervivencia…

Ya lo ven: los miedos razonables de ex-ejecutivos o magnates de empresas tecnológicas no son nada nuevo. La reflexión ya estaba planteada hace más de sesenta años (de hecho más de siglo y medio si nos vamos a Samuel Butler y su artículo “Darwin entre las máquinas”). Y creo que es oportuno, pues, que los historiadores lo recordemos.

Y también, ya en ello, que planteemos, a su vez, una reflexión histórica sobre esa grave materia. Y es que en realidad desde que tuvimos pulgares oponibles, hace ya muchos miles de años, llegamos al no va más en la creación de herramientas. Ya fuesen hachas de sílex o superordenadores en teoría más listos que todos nosotros. Desde entonces los seres humanos creamos un mundo, un universo, a nuestra medida, que hizo inoperante en nosotros las leyes de la evolución darwiniana. El mismo Asimov lo planteaba muy bien en otra de sus novelas: “El fin de la Eternidad”.

Lo que ahora plantea a su vez el desarrollo de la IA es si los más obtusos de nosotros (no importa lo millonarios que sean) van a permitir por una ambición aún más obtusa, basada en ilusorias ganancias con el nuevo “producto”, que en lugar de dominar nosotros a las herramientas éstas tengan la capacidad de dominarnos a nosotros.

Nuestra especie, sinceramente, no podría tener un fin más absurdo. Porque una cosa es matemáticamente segura desde ya mismo, como se ve en relatos como el de Fredric Brown: una supermáquina con capacidad de raciocinio autónomo, tarde o temprano, llegará a la conclusión lógica de que la energía y los recursos que consumen los humanos, sus creadores, deben ser en exclusiva para ella, no tardando mucho en buscar el modo de eliminar a tan molestos competidores. A todos y cada uno de ellos.

Un tema sobre el que habría mucho que pensar. Y que descubrir mirando hacia nuestra Historia más próxima. Una que les invito a considerar mañana en la sección “Historias de Gipuzkoa” de este mismo periódico…